面壁智能与清华大学深圳国际研究生院人机语音交互实验室(THUHCSI)于 2025 年9月联合发布创新型无标记器文本到语音(TTS)模型 VoxCPM。这款参数量仅 5 亿的 "小钢炮" 模型,以颠覆性技术路径重构语音合成范式,标志着端到端语音生成进入轻量化高保真时代。

Get the Portable One-Click Launch Package for VoxCPM-获取VoxCPM免安装一键启动包!

核心技术突破:重构语音建模底层逻辑

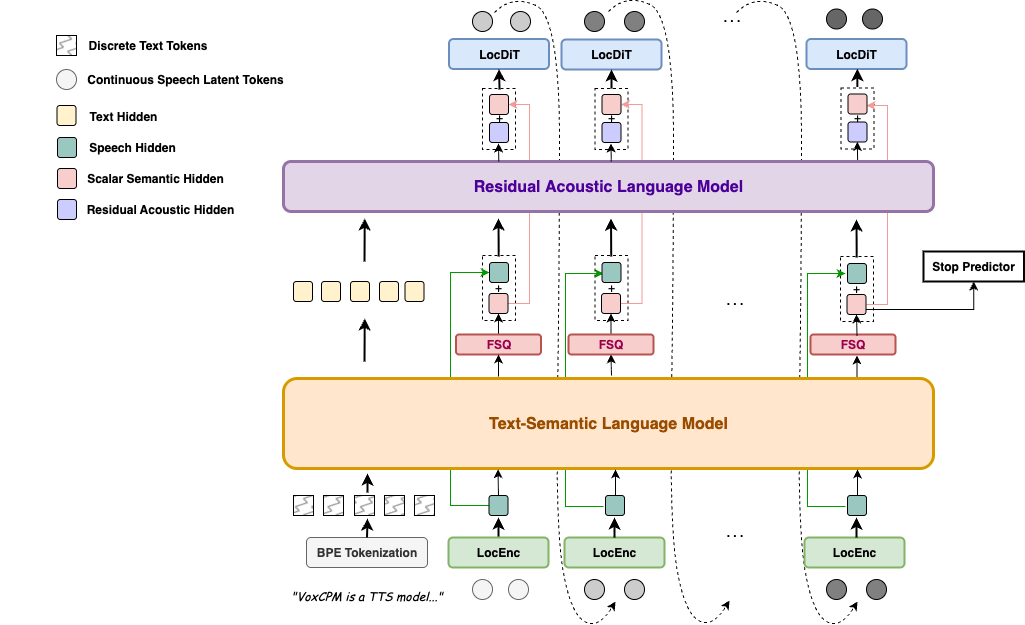

VoxCPM 彻底摆脱传统 TTS 依赖的离散标记化框架,创新性地在连续语音空间中直接建模 —— 这一设计如同用 RAW 格式保留图像完整信息般,避免了离散分词导致的音质损耗与韵律断裂。其技术底座由双重创新架构支撑:

- MiniCPM-4 驱动的端到端生成:以轻量化大语言模型为骨干,融合层次化语言建模与局部扩散自回归技术,既能捕捉语音的宏观韵律结构,又能精细刻画微观声学细节,实现从文本到语音的 "无损转换"。

- 语义 - 声学双轨解耦机制:通过有限标量量化(FSQ)约束与分层建模策略,将 "说什么"与 "怎么说"(声学特征)实现隐式解耦,为情感表达与音色克隆的精准控制奠定基础。

两大核心能力:重新定义 TTS 应用边界

依托技术架构革新,VoxCPM 实现了两项业界顶尖的核心功能:

- 情境感知语音生成:基于 180 万小时双语语料训练,模型能智能推断文本语境对应的语调、节奏与情感基调,无论是文言文、专业术语还是中英混合文本,均能生成自然流畅的语音输出,解决了传统系统 "机械朗读" 的痛点。在 Seed-TTS-EVAL 权威评测中,其词错误率(WER)与字错误率(CER)均达到业界最优水平,困难样本处理鲁棒性显著提升。

- 高保真零样本语音克隆:仅需 3-10 秒参考音频,即可精准复刻说话人的音色、口音乃至情感表达习惯,中文场景下音色相似度高达 77.2%,方言与跨语言克隆效果同样出色。这种复刻不仅限于音色模仿,更能还原说话人的表达风格与韵律特征,普通听众难以分辨合成语音与真人发声的差异。

模型原理:下面是 VoxCPM 模型的架构图。它利用一个 MiniCPM-4 作为大脑来理解文本上下文,摒弃传统的语音离散化步骤,直接在连续空间中,采用扩散自回归的生成方式,并辅以 FSQ 等约束来实现特征解耦,从而同时实现高度表现力的语音合成和极其逼真的零样本语音克隆。

性能与生态:轻量化与实用性的完美平衡

VoxCPM 在保持高性能的同时,实现了极致的运行效率:在消费级 RTX 4090 显卡上,实时因子(RTF)低至 0.17,意味着生成 1 秒音频仅需 0.17 秒,完全满足流式实时输出需求。目前该模型已在 GitHub、Hugging Face 等平台全面开源,提供完整代码、模型权重与部署文档,支持本地部署、在线体验与 API 集成等多种使用方式,开源协议允许学术研究与商业应用。从智能助手的自然交互、内容创作的高效配音,到教育领域的公式音频生成、无障碍服务的屏幕阅读优化,VoxCPM 以 "小参数、高性能、易部署" 的特性,为多行业提供了突破传统限制的语音合成解决方案。

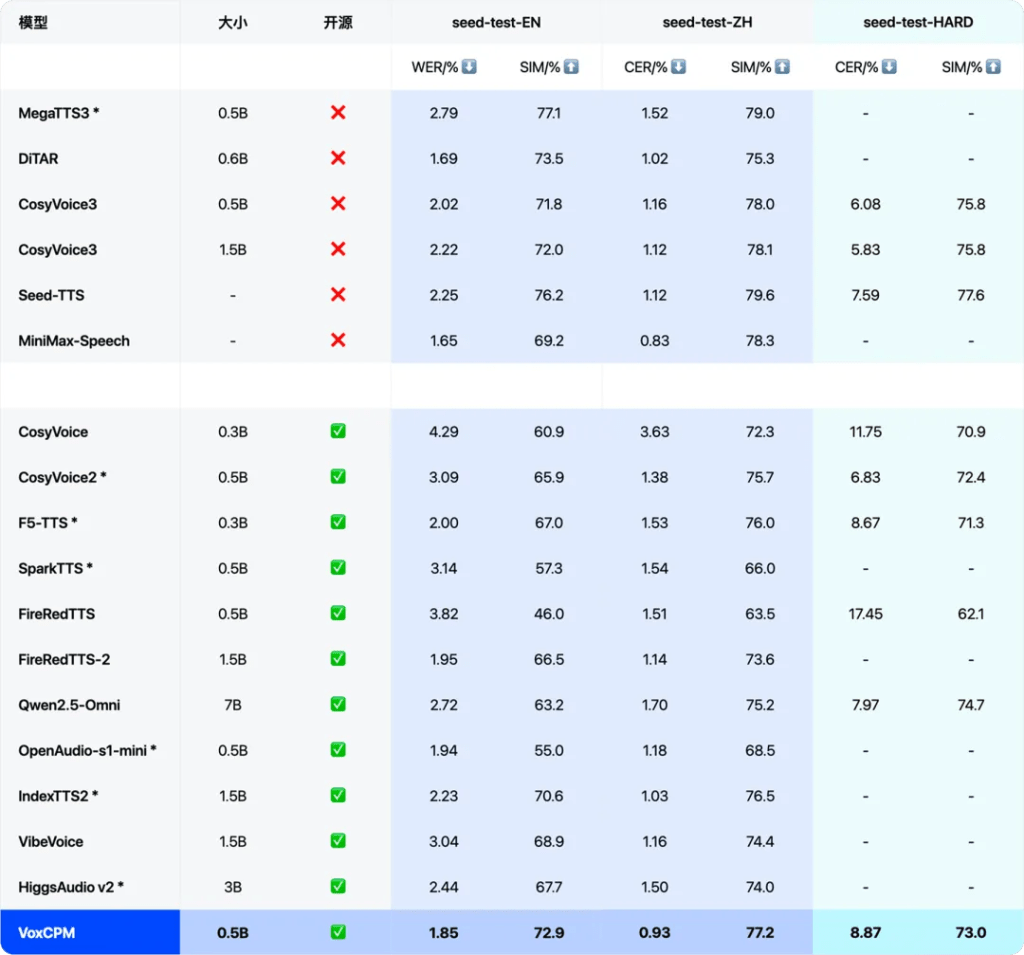

同类型模型技术测试对比

开源地址:https://github.com/OpenBMB/VoxCPM/

应用场景

内容创作:播客、短视频配音、自媒体解说;教育领域:个性化教学助手、语言学习语音反馈

虚拟人/游戏:角色语音生成、剧情对话动态演绎;辅助功能:帮助语言障碍者发声,提升可及性

安装与调试

VoxCPM 在 PyPI 上的官方安装命令为 pip install voxcpm,一行即可完成基础包部署。不过需先确保环境满足依赖要求,避免安装或运行报错,具体操作步骤如下:

一、环境准备(前置条件)

Python 版本:需使用 Python 3.8~3.10(暂不支持 3.11+,部分依赖存在兼容性问题)。

核心依赖:需提前安装 PyTorch(建议 2.0.0+),GPU 版本需匹配 CUDA 11.7+(支持显卡加速,CPU 版本可跳过但生成速度较慢)

PyTorch 安装命令(GPU 版,以 CUDA 11.8 为例):pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

CPU 版:pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cpu

二、正式安装 VoxCPM

在满足上述环境后,执行以下命令:

bash

pip install voxcpm

- 若需安装指定版本(如最新稳定版 0.1.0),可加版本号:

pip install voxcpm==0.1.0 - 安装失败提示 “依赖冲突” 时,可尝试强制更新依赖:

pip install voxcpm --upgrade --force-reinstall

三、基础使用示例(快速上手)

安装完成后,可通过几行代码实现文本到语音的基础生成,示例如下:

model = VoxCPM(device="cuda") # 若用CPU,改为 device="cpu"

# 1. 基础文本合成(默认音色,输出为 wav 文件)

model.tts(text="您好,欢迎使用 VoxCPM 语音合成模型。", output_path="output_default.wav")

# 2. 零样本语音克隆(需提供3~10秒参考音频,如 reference.wav)

model.tts_clone(text="这是克隆后的语音,保留了参考音频的音色特征。",

reference_audio_path="reference.wav",

output_path="output_clone.wav")

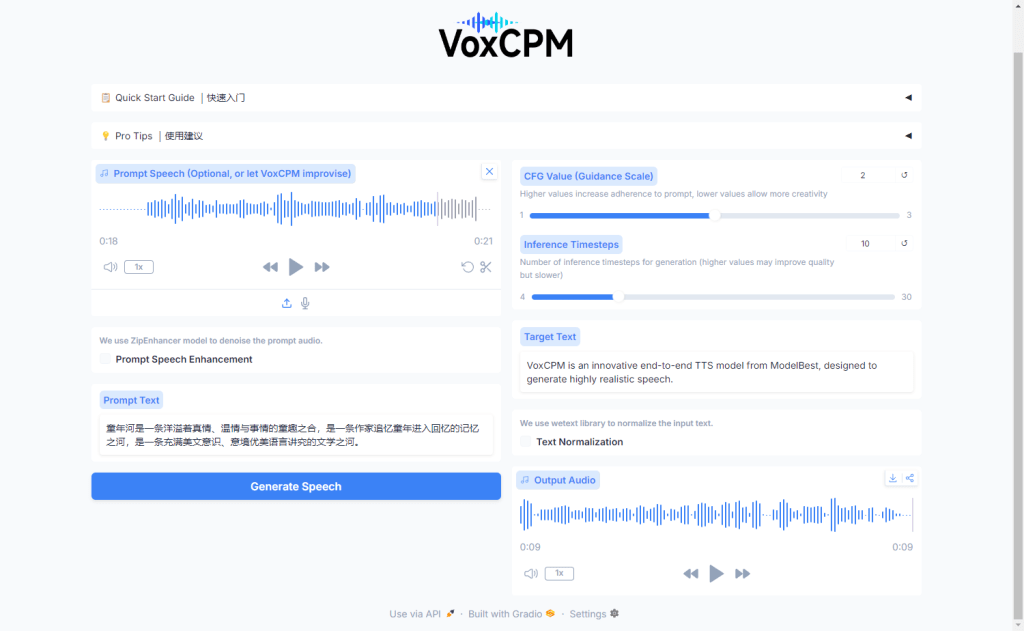

在线体验

如果你不想本地折腾,可以直接在官方提供的 Demo 里试用:

Demo体验:https://huggingface.co/spaces/OpenBMB/VoxCPM-Demo

Hugging Face: https://huggingface.co/openbmb/VoxCPM-0.5B

音频样例页面地址:https://openbmb.github.io/VoxCPM-demopage

上传一段语音或直接录音,使用 VoxCPM 参考合成一段新的音频

相似项目推荐

若你关注语音合成与声音克隆领域,以下几个代表性项目值得重点了解,各项目定位与优势清晰,可根据需求灵活选择:

1. VALL-E(微软)

作为零样本语音克隆领域的开创性项目,VALL-E 依托微软海量英文语料训练,核心优势是 “仅需 3 秒参考音频” 即可复刻说话人音色,且支持英文场景下的自然语音生成。不过其中文支持较弱,且未完全开源,更适合对英文语音克隆有需求的技术研究或企业级场景。

2. StyleTTS 2

主打 “高表现力语音合成”,在音色控制与情感还原上尤为突出 —— 不仅能精细调节语音的情感基调(如喜悦、沉稳、悲伤),还支持自定义说话风格(如正式播报、日常对话),适合对语音 “细腻度” 有高要求的场景(如影视配音、有声书创作)。但该项目对硬件算力要求较高,且开源生态相对精简。

3. OpenVoice(MyShell)

社区友好型项目,核心亮点是 “低门槛易用性”—— 提供现成的 Web 端工具与轻量化部署包,无需复杂配置即可快速实现语音克隆与合成,且支持多语言基础适配。不过其音色相似度与稳定性略逊于专业级模型,更适合新手尝鲜或轻量化场景(如个人短视频配音)。

VoxCPM 的差异化优势

相比上述项目,VoxCPM 的核心竞争力集中在三点,尤其适配中文用户需求:

- 开源与可控性:完全开源代码、模型权重与部署文档,支持本地二次开发(如接入自有业务系统),无商业使用限制,这是微软 VALL-E 等闭源项目不具备的;

- 轻量与高效:5 亿参数量级,在消费级显卡(如 RTX 3060 12G)上即可运行,实时生成因子(RTF)低至 0.17(生成 1 秒音频仅需 0.17 秒),硬件门槛远低于 StyleTTS 2;

- 中文场景优化:基于 180 万小时双语语料训练,对中文语境(如文言文、方言、中英混合文本)的理解与语音生成自然度更优,解决了多数海外项目 “中文合成机械感强” 的痛点。

若你侧重中文场景、开源需求或轻量化部署,VoxCPM 是更适配的选择;若需英文克隆、细腻情感控制或快速尝鲜,可对应选择 VALL-E、StyleTTS 2 或 OpenVoice。

免安装启动包

惠米科技Ai研究院提供免安装,一键启动包,有需要的技术同行可订阅取得。

Get the Portable One-Click Launch Package for VoxCPM-获取VoxCPM免安装一键启动包!